¿Estás listo para impulsar tu negocio en el mundo digital? En HiveAgile, sabemos lo crucial que es estar bien conectado en el entorno digital actual. Por eso, estamos emocionados de presentarte nuestros nuevos planes de membresía, pensados especialmente para adaptarse a lo que mejor te conviene, tanto en servicios como en presupuesto.

👉 Plan Mensual: Ideal para quienes buscan flexibilidad y compromiso a corto plazo. ¡Solo 12€ al mes! Haz clic aquí para más información

👉 Plan Trimestral Equilibrio perfecto entre compromiso y comodidad. 36€ cada tres meses. Descubre más aquí

👉 Plan Semestral: Únete a nosotros por seis meses a un precio especial de 73€. Infórmate más aquí

En HiveAgile, tu éxito es nuestra prioridad. Te ofrecemos la libertad de elegir cómo y cuándo invertir en tu crecimiento digital. ¡Es tu momento de destacar en el mundo digital con HiveAgile!

🌟 HiveAgile: Adaptándonos a ti, impulsando tu negocio.

Hola,

La intro de hoy no va dedicada a nadie en concreto, pero sí a todos los que alguna vez hemos dudado antes de subir documentos sensibles a servicios de IA en la nube. Esa sensación de "¿realmente debería enviar esto?" no es paranoia, es sentido común.

Mi reflexión del día es directa: la privacidad no debería ser un lujo. Podemos tener IA potente, embeddings de calidad y búsquedas semánticas sin sacrificar el control sobre nuestros datos. Es como tener tu propia biblioteca personal en lugar de prestar todos tus libros a un desconocido.

Y mientras pensaba en esto, recordé una frase que me marcó: "La verdadera libertad tecnológica llega cuando no dependes de nadie más para hacer tu trabajo". Con las herramientas adecuadas, podemos construir sistemas que rivalizan con cualquier solución corporativa.

Hoy quiero mostrarte exactamente eso: EmbeddingGemma + Ollama + Qdrant, una combinación que convierte tus documentos en un asistente IA completamente privado, capaz de responder preguntas complejas sin que un solo byte salga de tus servidores.

🧠 G33K TEAM de la Semana

¡Ya está aquí el episodio 20 de G33K Team! 🎙️

Esta semana, con la participación de Oriol Rius, Néstor y Tete, el equipo se adentra en un fascinante debate sobre el futuro de la web, el impacto de la inteligencia artificial y cómo la tecnología está moldeando nuestra sociedad y la forma en que consumimos información.

El Futuro de la Web y la Era de la IA

La conversación principal giró en torno a la evolución de la web y el papel cada vez más protagonista de la inteligencia artificial.

- De la Web 1.0 a la 2.0: Se recordó la transición de una web estática (Web 1.0), donde el contenido era unidireccional, a una web interactiva y social (Web 2.0), impulsada por la participación del usuario y la bidireccionalidad.

- La Web 3.0 y la IA: El equipo exploró cómo la inteligencia artificial está redefiniendo el concepto de búsqueda en internet. Herramientas como Perplexity ya no solo ofrecen enlaces, sino que generan respuestas resumidas y remezcladas a partir de múltiples fuentes, cambiando por completo la forma en que accedemos al conocimiento.

- El Origen de Perplexity: Tete compartió la inspiradora historia del fundador de Perplexity, un joven de la India que, gracias a una beca para un doctorado en Estados Unidos, se propuso competir con gigantes como Google y creó una herramienta que ha alcanzado el estatus de unicornio.

🤔 Reflexiones sobre la Tecnología y la Sociedad

El debate se extendió a reflexiones más profundas sobre el impacto de estos avances en nuestro día a día.

- La Brecha Digital Generacional: Se puso de manifiesto cómo las generaciones más mayores a menudo se quedan "fuera" de la evolución tecnológica, enfrentando dificultades con tareas cotidianas como la banca online o la gestión de citas médicas.

- El Abuso de la Tecnología: Se discutió sobre cómo en España, el uso de herramientas como WhatsApp a menudo se convierte en un "abuso", con una sobredosis de información y grupos que generan una carga mental considerable.

- Vivir a través de una Pantalla: Una de las reflexiones más interesantes fue cómo las nuevas generaciones están renunciando a la "experiencia inmersiva" del mundo real para consumirlo a través de una pequeña pantalla, perdiéndose la riqueza de la interacción directa.

- La Simplificación y el Marketing: El equipo concluyó que el marketing ha jugado un papel clave en simplificar conceptos tecnológicos para el gran público, como la asociación del término "PC" exclusivamente con Windows, aunque técnicamente no sea del todo correcto.

ℍ𝕠𝕣𝕚𝕫𝕠𝕟𝕥𝕖 𝔸𝕣𝕥𝕚𝕗𝕚𝕔𝕚𝕒𝕝

Te presentamos "Horizonte Artificial", la nueva y flamante sección de nuestra newsletter dedicada exclusivamente a la Inteligencia Artificial. Pero no esperes el contenido convencional que inunda TikTok o YouTube. Aquí, nos sumergiremos en el fascinante mundo del OpenSource, explorando proyectos libres que puedes desplegar en tu propio servidor. Y para guiarnos en esta travesía, contamos con la experticia de Jesús Pacheco, mejor conocido en nuestra comunidad HiveAgile como "Pachecodes". Prepárate para una perspectiva fresca y auténtica sobre la IA. ¡Bienvenidos al horizonte!

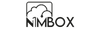

SpikingBrain: La Revolución de la IA Inspirada en el Cerebro Humano

Los investigadores de la Universidad de Beijing han desarrollado algo que podría cambiar fundamentalmente cómo pensamos sobre la inteligencia artificial. Su proyecto, llamado SpikingBrain, representa un salto radical desde los transformers tradicionales hacia una arquitectura que imita directamente el funcionamiento del cerebro humano.

Enlaces y recursos:

El Problema de los Transformers Actuales

Los modelos de lenguaje basados en transformers, como GPT o Claude, tienen un problema fundamental: procesan toda la información simultáneamente a máxima potencia. Imagina tener que encender todas las luces de una ciudad, incluso en habitaciones vacías, cada vez que alguien necesita iluminación. Esto es exactamente lo que hacen los transformers con cada neurona artificial en cada cálculo.

Esta ineficiencia tiene consecuencias reales:

- Costo computacional cuadrático: el procesamiento se vuelve exponencialmente más caro con secuencias largas

- Consumo energético masivo: millones de dólares en electricidad para entrenar y ejecutar modelos

- Memoria lineal: textos más largos requieren proporcionalmente más memoria

- Dependencia de hardware específico: principalmente GPUs NVIDIA de alta gama

La Inspiración Biológica: Cómo Funciona Realmente Nuestro Cerebro

Los investigadores chinos se hicieron una pregunta simple pero profunda: ¿por qué no copiar directamente al cerebro humano?

En nuestro cerebro, las neuronas no están constantemente activas. Permanecen en reposo hasta que algo importante sucede, momento en el cual "disparan" una señal eléctrica breve (spike) al siguiente neurón. Este comportamiento esporádico y selectivo es lo que permite que nuestro cerebro sea increíblemente eficiente energéticamente.

La Arquitectura SpikingBrain

Redes Neuronales de Spikes (Spiking Neural Networks)

SpikingBrain implementa lo que se conoce como Spiking Neural Networks con varias innovaciones clave:

1. Neuronas con Umbral Adaptativo

- En lugar de usar un umbral fijo para el disparo, cada neurona ajusta dinámicamente su sensibilidad

- Esto evita que las neuronas estén sobreexcitadas o completamente silenciosas

- El sistema se autorregula estadísticamente

2. Atención Híbrida Linear

- Combina diferentes tipos de atención: lineal, de ventana deslizante y softmax tradicional

- La complejidad computacional se reduce de O(n²) a O(n) para secuencias largas

- Mantiene capacidades globales mientras optimiza el procesamiento local

3. Mixture of Experts (MoE) Bio-inspirado

- Solo activa los "expertos" neuronales necesarios para cada token

- Imita la especialización modular del cerebro humano

- Reduce drasticamente el uso de parámetros activos

Resultados Impresionantes

Los números hablan por sí solos:

- 100x más rápido en tiempo hasta el primer token para secuencias de 4 millones de tokens

- 97% menos consumo energético comparado con modelos tradicionales

- Solo 2% de los datos de entrenamiento necesarios versus modelos convencionales

- 69% de dispersión en las activaciones, meaning la mayoría de neuronas permanecen inactivas

Modelos Desarrollados

- SpikingBrain-7B: Modelo puramente lineal optimizado para eficiencia en contextos largos

- SpikingBrain-76B: Modelo híbrido con 76B parámetros totales pero solo 12B activos por token

Ambos modelos logran rendimiento comparable a sus equivalentes tradicionales (Mistral-7B, Llama-70B) pero con una fracción del costo computacional.

Implementación en Hardware No-NVIDIA

Un aspecto particularmente notable es que estos modelos fueron entrenados completamente en hardware chino (GPUs MetaX), demostrando independencia tecnológica. Los investigadores desarrollaron:

- Adaptaciones completas de CUDA a MACA (framework chino)

- Optimizaciones específicas para el hardware MetaX

- Operadores personalizados para atención linear y spiking

Codificación de Spikes: Del Concepto a la Implementación

La codificación de spikes convierte activaciones continuas en secuencias de eventos discretos:

- Codificación Binaria {0,1}: La más básica

- Codificación Ternaria {-1,0,1}: Incluye spikes inhibitorios

- Codificación Bitwise: Compresión extrema para escenarios de alta precisión

Esta aproximación permite dos modos de operación:

- GPU tradicional: Colapsa la dimensión temporal para compatibilidad

- Hardware neuromórfico: Expansión temporal completa para computación asíncrona

Comparativa de Rendimiento

| Modelo | MMLU | CMMLU | Parámetros | Tokens Entrenamiento |

|---|---|---|---|---|

| SpikingBrain-7B | 65.84 | 71.58 | 7B | +150B |

| Qwen2.5-7B | 74.21 | 81.73 | 7B | 7T |

| SpikingBrain-76B | 73.58 | 78.83 | 12B/76B | +160B |

| Mixtral-8×7B | 71.23 | 52.70 | 13B/47B | ~1T |

El SpikingBrain-7B recupera aproximadamente el 90% del rendimiento del modelo base usando solo el 2% de los datos de entrenamiento.

Implicaciones y Limitaciones

Ventajas Transformadoras

- Eficiencia energética radical para aplicaciones edge

- Escalabilidad mejorada para contextos ultra-largos

- Arquitectura más alineada con principios biológicos

- Independencia de ecosistemas de hardware propietarios

Consideraciones Críticas

- Gap de rendimiento del ~10% versus modelos base en tareas específicas

- Complejidad adicional en el pipeline de entrenamiento

- Necesidad de hardware especializado para máximo beneficio

- Ecosistema de herramientas aún en desarrollo

El Futuro de la IA Bio-Inspirada

SpikingBrain representa más que una optimización técnica: es un cambio de paradigma hacia arquitecturas que respetan los principios fundamentales de la computación biológica. Mientras los transformers buscan más datos y más parámetros, esta aproximación busca la elegancia eficiente del cerebro.

La pregunta no es si esta tecnología será adoptada, sino qué tan rápido podremos adaptar nuestros sistemas actuales para aprovechar estos principios. En un mundo cada vez más consciente del costo energético de la IA, SpikingBrain podría ser la clave para hacer la inteligencia artificial verdaderamente sostenible.

En el contexto actual donde el entrenamiento de un modelo grande puede costar millones de dólares y consumir la electricidad de una ciudad pequeña, la propuesta de reducir estos costos en un 97% no es solo una mejora técnica: es una necesidad urgente para el futuro sostenible de la IA.

El código y modelos de SpikingBrain están disponibles públicamente, permitiendo que la comunidad global explore y desarrolle sobre estos fundamentos bio-inspirados.

🌟 TopGit - Resumen Semanal (2025-09-21)

📚 Repositorios Destacados de la Semana

Los siguientes repositorios han sido seleccionados por su relevancia, calidad y métricas de GitHub:

🔧 🧠 Framework Genkit

Genkit es un marco de código abierto para construir aplicaciones impulsadas por IA en JavaScript, Go y Python, desarrollado y utilizado en producción por Google. Ofrece SDKs para múltiples lenguajes, permitiendo una integración simplificada de modelos de IA y facilitando el desarrollo ágil de chatbots, automatizaciones y sistemas de recomendación.

📊 Estadísticas de GitHub:

- ⭐ 3,854 estrellas

- 🔄 441 forks

- 👀 55 observadores

- 📝 674 issues abiertos

- 🔤 Principal lenguaje: TypeScript

🔧 🌐 Fleet: Gestión de Dispositivos Abierta

Fleet es una plataforma de código abierto diseñada para la gestión de dispositivos, optimizando la seguridad y el monitoreo de salud de los dispositivos en las organizaciones. Permite integrar APIs, GitOps, webhooks y configuraciones en YAML, enfocándose en la simplicidad y la flexibilidad para adaptarse a diferentes entornos.

📊 Estadísticas de GitHub:

- ⭐ 5,546 estrellas

- 🔄 670 forks

- 👀 47 observadores

- 📝 2,776 issues abiertos

- 🔤 Principal lenguaje: Go

🔧 🤖 AgentScope: Programación Orientada a Agentes

AgentScope es un marco de trabajo diseñado para la programación orientada a agentes que permite desarrollar aplicaciones basadas en modelos de lenguaje (LLM). Es ideal tanto para principiantes como para expertos, ofreciendo un entorno claro y controlable para la construcción de agentes. Este framework incluye soporte para la gestión de herramientas, memoria a largo plazo y la ejecución en tiempo real, lo que lo hace altamente personalizable y adecuado para construcciones de múltiples agentes.

📊 Estadísticas de GitHub:

- ⭐ 12,123 estrellas

- 🔄 940 forks

- 👀 72 observadores

- 📝 48 issues abiertos

- 🔤 Principal lenguaje: Python

🔧 🛡️ Cariddi - Escáner de Dominios

Cariddi es una herramienta que permite tomar una lista de dominios, rastrear URLs y escanear en búsqueda de puntos finales, secretos, claves API, extensiones de archivo, tokens y más. Ideal para auditorías de seguridad y pruebas de vulnerabilidad en aplicaciones web, Cariddi ayuda a identificar información sensible expuesta en servicios en línea.

📊 Estadísticas de GitHub:

- ⭐ 2,776 estrellas

- 🔄 250 forks

- 👀 17 observadores

- 📝 13 issues abiertos

- 🔤 Principal lenguaje: Go

🔧 🧠 Contenedores MCP de Metorial

Los contenedores MCP de Metorial son versiones encapsuladas de varios servidores del Protocolo de Contexto de Modelo (MCP). Facilitan la configuración y el uso de estos servidores para desarrolladores y usuarios interesados en la integración de IA. Con esta herramienta, puedes desplegar rápidamente contenedores para distintos Servicios MCP, permitiendo acceder a diversas funcionalidades de IA, todo en un entorno seguro.

📊 Estadísticas de GitHub:

- ⭐ 2,809 estrellas

- 🔄 305 forks

- 👀 21 observadores

- 📝 0 issues abiertos

- 🔤 Principal lenguaje: TypeScript

🔧 🚀 Creación de Avatar Digital

WeClone es una solución integral para crear un avatar digital a partir de tu historial de chat. Permite afinar modelos de lenguaje con tus registros de chat, capturando tu estilo único y llevándolo a un chatbot que representa tu 'yo' digital. Con soporte para plataformas de mensajería como Telegram, es fácil de usar y personalizar, ofreciendo una experiencia única para crear avatares digitales que reflejan tu personalidad.

📊 Estadísticas de GitHub:

- ⭐ 15,519 estrellas

- 🔄 1,226 forks

- 👀 72 observadores

- 📝 36 issues abiertos

- 🔤 Principal lenguaje: Python

🔧 🔥 1Panel - Panel de Control para Servidores Linux

1Panel es un panel de control basado en web de código abierto para la gestión de servidores Linux. Permite administrar sitios web, archivos, contenedores, bases de datos y gestión de LLMs de manera eficiente a través de una interfaz gráfica de usuario intuitiva. Con características como implementación rápida de sitios web y gestión de seguridad, 1Panel se convierte en la solución ideal para quienes buscan facilitar la administración de sus servidores en un entorno seguro y confiable.

📊 Estadísticas de GitHub:

- ⭐ 31,359 estrellas

- 🔄 2,751 forks

- 👀 186 observadores

- 📝 503 issues abiertos

- 🔤 Principal lenguaje: Go

🔧 🛡️ JumpServer - Gestión de Acceso Privilegiado

JumpServer es una plataforma de gestión de acceso privilegiado (PAM) de código abierto que proporciona a los equipos de DevOps e IT acceso seguro y bajo demanda a SSH, RDP, Kubernetes, bases de datos y puntos finales de RemoteApp a través de un navegador web.

📊 Estadísticas de GitHub:

- ⭐ 28,711 estrellas

- 🔄 5,556 forks

- 👀 664 observadores

- 📝 31 issues abiertos

- 🔤 Principal lenguaje: Python

🔧 💻 D2: Lenguaje de Scripting para Diagramas

D2 es un lenguaje de scripting moderno que convierte texto en diagramas, permitiendo a los usuarios crear visualizaciones de datos de manera sencilla y rápida. Su objetivo es facilitar la creación de diagramas utilizando una sintaxis clara y compacta, ideal para desarrolladores y diseñadores.

- Características: Utiliza un formato de texto simple; exporta a SVG, PNG y PDF; soporta múltiples temas y fuentes; y es fácilmente extendible mediante plugins.

- Beneficios: Agiliza el proceso de diagramación, permite la edición en tiempo real y fomenta la colaboratividad en proyectos de visualización.

- Casos de uso: Ideal para la documentación de arquitectura de software, diagramas de flujo, y visualización de datos en tiempo real.

📊 Estadísticas de GitHub:

- ⭐ 21,924 estrellas

- 🔄 572 forks

- 👀 80 observadores

- 📝 451 issues abiertos

- 🔤 Principal lenguaje: Go

🔧 📚 Generador de Audiolibros

Abogen es una poderosa herramienta de conversión de texto a voz que facilita transformar archivos ePub, PDF o de texto en audio de alta calidad con subtítulos sincronizados en segundos. Es ideal para audiolibros, voces en off para proyectos en redes sociales, o cualquier proyecto que necesite una voz natural.

📊 Estadísticas de GitHub:

- ⭐ 3,589 estrellas

- 🔄 190 forks

- 👀 18 observadores

- 📝 12 issues abiertos

- 🔤 Principal lenguaje: Python

📊 Análisis de Distribución por Categorías

La siguiente gráfica muestra la distribución de proyectos por categoría en TopGit:

📈 Estadísticas Semanales

🏆 Top 3 Categorías

📊 Distribución Detallada

🔧 Dev █████████ 45% (9 repos)

🤖 IA & Machine Learning ██████ 30% (6 repos)

🌐 Web Development ███ 15% (3 repos)

🔧 Otros █ 5% (1 repos)

🚀 Tendencias Destacadas

📈 Métricas Clave

- Repositorios Totales: 20

- Promedio Diario: 2.9 repos/día

- Categorías Activas: 5

🎯 Categorías Dominantes

- Dev

- 9 repositorios

- 45.0% del total

- IA & Machine Learning

- 6 repositorios

- 30.0% del total

- Web Development

- 3 repositorios

- 15.0% del total

💡 Análisis de Tendencias

En los repositorios GitHub de esta semana, hay una serie de tendencias notables. Estas son algunas de las que más destacan:

- Aplicaciones Impulsadas por la Inteligencia Artificial (IA): Muchos de los proyectos destacados están relacionados con la inteligencia artificial, incluyendo el Framework Genkit, AgentScope, Contenedores MCP de Metorial, y la Creación de Avatar Digital. Esto no es sorprendente, ya que la tecnología de inteligencia artificial sigue en auge, y está siendo aplicada en una variedad cada vez mayor de contextos y aplicaciones.

- Gestión de Servicios y Recursos Digitales: Varios de los proyectos destacados también involucran el monitoreo, la gestión y la seguridad de los recursos digitales. Fleet, por ejemplo, es una plataforma de código abierto que se especializa en la gestión de dispositivos, mientras que el 1Panel es un panel de control para servidores Linux y el JumpServer se enfoca en la gestión de acceso privilegiado.

- Herramientas de Comunicación y Colaboración: Destaca la aparición de herramientas que facilitan la comunicación y la colaboración digital. El generador de audiolibros Abogen, por ejemplo, tiene aplicaciones tanto para individuos como para empresas, mientras que D2 se utiliza para crear diagramas a partir de texto, facilitando la visualización de datos y la colaboración en proyectos de software.

- Seguridad en Línea: Como era de esperar, la seguridad en línea sigue siendo una tendencia importante. Esto es evidente en el Proyecto Cariddi, una herramienta que escanea dominios en busca de información sensible.

- Open Source: Al igual que en informes anteriores, la tendencia hacia el código abierto sigue siendo fuerte. Todos los proyectos destacados en esta lista son de código abierto, lo que permite a los desarrolladores contribuir al proyecto y adaptarlo a sus propias necesidades.

En resumen, los desarrolladores están aprovechando las últimas tendencias tecnológicas como la inteligencia artificial y la seguridad en línea, así como la creciente importancia de la comunicación y colaboración digitales, para crear herramientas innovadoras y útiles. Además

- 🐥 Únete a nuestra vibrante comunidad en Twitter y mantente en la vanguardia: descubre herramientas innovadoras, participa en nuestro emocionante #BuildInPublic y mucho más.

- 💌 ¿Tienes algo que compartir? No dudes en contactarnos. Tu voz es importante para nosotros y nos comprometemos a responder a la mayor brevedad posible.¡házmelo saber!

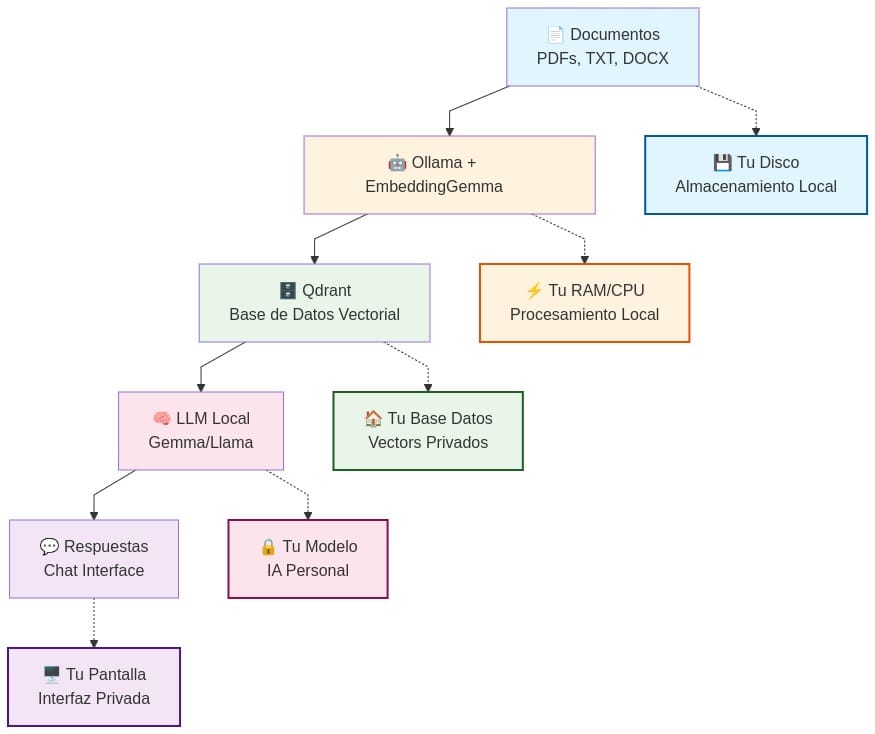

RAG Totalmente Privado: La Guía Definitiva con EmbeddingGemma, Ollama y Qdrant

Cómo construir un sistema de IA que nunca traiciona tus secretos

Madrid, oficinas de TechCorp, 3:00 AM

Elena, la CTO de una startup fintech, no podía dormir. Acababa de leer en las noticias que otra empresa había sufrido una filtración masiva de datos. Miles de documentos confidenciales, estrategias comerciales y datos de clientes habían terminado en manos equivocadas. Todo porque confiaron sus documentos más sensibles a un servicio de IA en la nube que prometía "máxima seguridad".

Esa madrugada, Elena tomó una decisión que cambiaría el futuro de su empresa: nunca más sus datos saldrían de sus servidores. Pero necesitaba IA. Su equipo dependía de sistemas inteligentes para analizar contratos, extraer insights de documentos financieros y responder preguntas complejas sobre regulaciones bancarias.

La solución parecía imposible hasta que descubrió EmbeddingGemma, Ollama y Qdrant. En 72 horas, había construido un sistema RAG completamente privado que superaba en rendimiento a las soluciones en la nube que habían estado usando. Esta es la historia de cómo lo hizo, y cómo tú puedes replicarlo.

El Problema Real: Cuando la IA en la Nube se Convierte en tu Peor Pesadilla

Los Riesgos Ocultos de los Embeddings en la Nube

Cada vez que envías un documento a OpenAI, Google Cloud o cualquier servicio de embedding externo, estás realizando una transferencia de conocimiento irreversible. Tus datos no solo viajan por internet (vulnerable a interceptación), sino que:

- Se almacenan temporalmente en servidores externos para procesamiento

- Pueden ser utilizados para mejoras del modelo (aunque las empresas lo nieguen)

- Están sujetos a las leyes del país donde están los servidores

- Pueden ser comprometidos en brechas de seguridad

- Generan costos escalables que pueden volverse insostenibles

El Costo Real de la "Conveniencia"

Veamos un ejemplo real. Una empresa mediana que procesa 1,000 documentos al mes usando embeddings de OpenAI:

- Costo directo: ~$50-100 USD/mes

- Costo indirecto: Riesgo de filtración de datos invaluable

- Dependencia: Sin internet, sin IA

- Escalabilidad: Los costos crecen linealmente con el uso

Con un sistema local, esos $600-1,200 USD anuales se convierten en una inversión única en hardware que, además, procesa datos más rápido y con mayor privacidad.

La Revolución Local: EmbeddingGemma + Ollama + Qdrant

¿Por qué Esta Combinación es Perfecta?

EmbeddingGemma: El modelo de Google que cambió las reglas

- 308M parámetros vs 1.5B+ de otros modelos

- Rendimiento superior en benchmarks multilingües

- Optimizado específicamente para ejecución local

- Soporte nativo para 100+ idiomas

Ollama: El motor que democratiza la IA

- Instalación en una línea de comando

- API compatible con OpenAI

- Gestión automática de memoria

- Optimizaciones hardware específicas

Qdrant: La base de datos vectorial del futuro

- Búsquedas ultrarrápidas (< 10ms)

- Filtros metadata avanzados

- Escalabilidad horizontal

- API REST simple pero potente

La Arquitectura del Sistema Perfecto

Todo ocurre en tu infraestructura. Cero bytes salen al exterior.

Implementación Paso a Paso: RAG Privado Simplificado

Fase 1: Configuración del Entorno (15 minutos)

Paso 1: Preparar el Sistema

Crear directorio del proyecto:

Leer la historia completa

Registrarse ahora para leer la historia completa y obtener acceso a todos los puestos para sólo suscriptores de pago.

Suscribirse